Stable Diffusion 快速创作角色三视图

发布时间:2024年06月06日

天分享分享如何通过 Stable Diffusion 快速创造出角色三视图。

这节会涉及到 ControlNet 中的 openpose 模型和 LoRA模型CharTurnerBeta - Lora (EXPERIMENTAL)(这个模型非必备哈)。

如果你忘了 ControlNet 的使用,可以翻看前面的教程哦。

一 流程介绍

整个流程原理很简单,我们通过使用 ControlNet Openpose 模型根据我们上传的三视图骨骼图进行渲染。结合CharTurnerBeta Lora

模型增强效果。最后就能得到一张角色三视图

“

CharTurnerBeta

Lora 的权重在 0.2-0.4 之间

”

二 使用

第一步:设置基础参数

模型:Deliberate_v2

提示词:(white background:1.5),A photographic style character turnaround of a an 1800's flamboyant pirate captain with a big feather in his hat and a peg leg. Parrot, eyepatch, mustache, grin, highly detailed face. Multiple views of the same character in the same outfit,<lora:mw_charturn3:0.4> charturnbetalora采样方法:DPM++ 2M SDE Karras

种子:703262763

宽高:880x512

adetail:face_yolov8s.pt

如果不启用 ControlNet 直接出图看看效果

有一点点效果,但是三视图的效果不是很好,接着我们设置 ControlNet

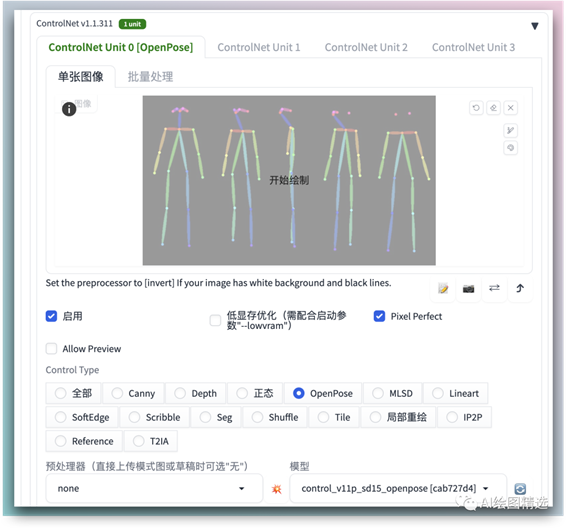

第二步:启用ControlNet

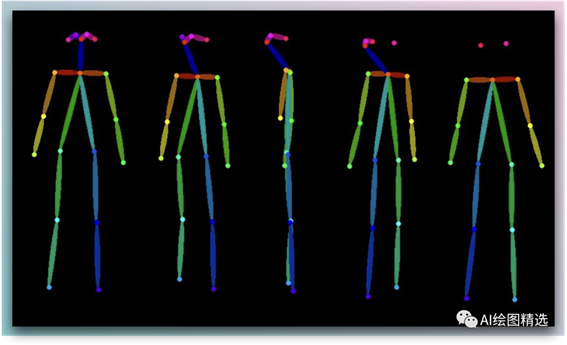

上传三视图特征图(不需要设置 预处理器),只需要将 ControlNet 模型设置为 openpose 模型。原图:https://images-1257364845.cos.ap-nanjing.myqcloud.com/6461E5A8-C04E-81C2-5CD7-BE8498BAE365.jpeg%60%20-%3E%20%60Image.jpeg

上传三视图特征图(不需要设置 预处理器),只需要将 ControlNet 模型设置为 openpose 模型。原图:https://images-1257364845.cos.ap-nanjing.myqcloud.com/6461E5A8-C04E-81C2-5CD7-BE8498BAE365.jpeg%60%20-%3E%20%60Image.jpeg

接着我们再次出图看看效果

这一次效果就好很多了。三视图特征图大家也可以通过其它渠道或者自己通过3d openpose自己设置。

在来看看其他模型的三视图效果图

出自:https://mp.weixin.qq.com/s/KrSzWCbdU6QN0SMYu3wciQ

素材搜集、视频剪辑、后期包装、渲染导出、在线剪辑平台